使用本地模型

若您已具备算力服务器,且完成大模型的本地部署,只需在 VJSP 中完成相关配置,即可直接调用并使用该本地模型。

ⓘ 信息

拥有多个配置文件可以让你快速切换不同的模型和设置,而无需每次更改设置时都重新配置所有内容。

配置前准备

在开始配置前,请确认以下信息:

| 信息项 | 说明 | 示例 |

|---|---|---|

| 服务器地址 | 内网服务器的 IP 地址或主机名 | 192.168.1.1 或 ai-server.com |

| 服务端口 | 模型服务监听的端口 | 比如11434 或 8000 |

| API 路径 | API 接口的完整路径 | /v1 |

| API 密钥 | 部署模型设置的API 密钥 | sk-xxx... |

如何获取这些信息?

询问服务器管理员:获取服务器地址、端口和认证信息

查看服务器文档:模型服务通常有配置文档

测试连接:使用 curl 测试 API 是否可访问

bash

# 测试 API 是否可访问(替换为你的服务器地址)

curl http://192.168.1.1:11434/v1工作原理

每个配置文件均可独立维护以下内容:

API 密钥与身份验证信息

模型选择

温度设置用于控制响应随机性

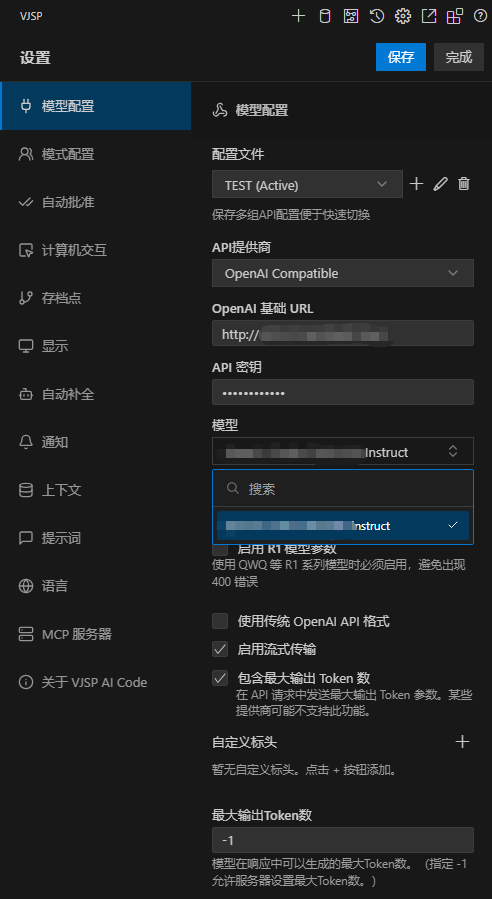

在VJSP中设置

步骤 1:打开模型配置

- 在IDE中,点击VJSP图标

- 点击右上角的「设置」界面,

- 选择「模型配置」选项卡,进入设置页面。

注意:

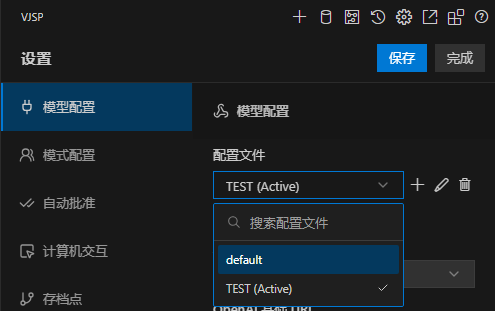

default是 VJSP 默认配置好的配置文件,不建议修改。如需使用本地模型,请创建新的配置文件。

步骤 2:创建新配置

点击 「+」 按钮创建新的配置文件。

步骤 3:填写配置参数

| 配置项 | 填写说明 | 示例值 |

|---|---|---|

| 配置文件名称 | 自定义名称,便于识别 | 内网-Qwen3.5或 TEST |

| API 提供商 | 选择 OpenAI Compatible | OpenAI Compatible |

| OpenAI 基础 URL | 本地大模型服务器的完整 API 地址 | http://192.168.1.1:11434/v1 |

| API 密钥 | 服务器要求的API密钥(如无认证可填任意值不能为空) | sk-xxx... |

步骤 4:选择模型

填写正确的服务器地址和密钥后,模型列表会自动从服务器加载到下拉菜单中。

- 从下拉菜单中选择需要的模型

- 无需手动输入模型名称

步骤 5:高级设置(可选)

根据实际需求调整以下设置:

| 设置项 | 说明 | 推荐值 |

|---|---|---|

| 启用 R1 模型参数 | 使用 QWQ/R1 系列模型时启用 | 使用 R1 模型时勾选 |

| 使用传统 OpenAI API 格式 | 兼容旧版 API | 根据服务器要求 |

| 启用流式传输 | 支持流式响应 | ✓ 建议勾选 |

| 包含最大输出 Token 数 | 限制输出长度 | ✓ 建议勾选 |

步骤 6:保存并测试

- 点击 「保存」 按钮

- 在会话窗口中选择新配置的模型

- 发送测试消息验证连接

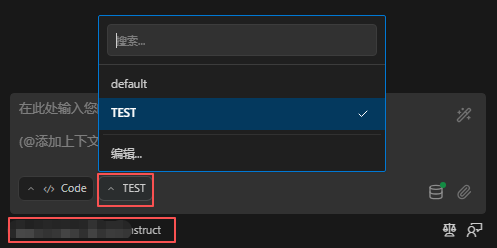

切换配置文件

支持两种快速切换方式:

- 在设置面板中,从下拉菜单直接选择配置文件。

- 在聊天界面中,使用顶部 API 配置下拉菜单切换。

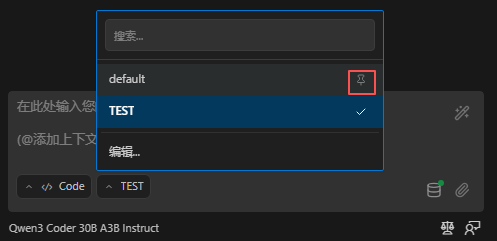

固定和排序配置文件

你可以固定常用配置文件,提升切换效率:

- 将鼠标悬停在配置文件上,显示图钉图标。

- 点击图钉即可固定该配置文件。

- 已固定文件显示在菜单顶部,按字母顺序排序。

- 未固定文件显示在分隔符下方,同样按字母顺序排序。

- 再次点击图钉可取消固定。

此功能使你更容易在常用配置文件之间导航,尤其是在你有许多配置时。

编辑和删除配置文件

在设置中选中配置文件,可修改任意参数。

点击铅笔图标可重命名配置文件。

点击垃圾桶图标可删除配置文件(无法删除最后一个配置文件)。

安全说明

API 密钥会安全存储在 IDE 的加密存储(Secret Storage)中,不会以明文形式暴露。