ローカルモデルの使用

算力サーバーを既に保有しており、大規模モデルのローカルデプロイを完了している場合、VJSP 内で関連設定を完了するだけで、このローカルモデルを直接呼び出して使用できます。

ⓘ 情報

複数の設定ファイルを持つことで、設定を変更するたびにすべてを再設定することなく、異なるモデルと設定をすばやく切り替えることができます。

設定前の準備

設定を開始する前に、以下の情報を確認してください:

| 情報項目 | 説明 | 例 |

|---|---|---|

| サーバーアドレス | 内部ネットワークサーバーの IP アドレスまたはホスト名 | 192.168.1.1 または ai-server.com |

| サーバーポート | モデルサービスがリスンするポート | 例:11434 または 8000 |

| API パス | API インターフェースの完全なパス | /v1 |

| API キー | デプロイされたモデルに設定された API キー | sk-xxx... |

これらの情報の取得方法

サーバー管理者に確認: サーバーアドレス、ポート、認証情報を取得

サーバードキュメントを確認: モデルサービスには通常設定ドキュメントがあります

接続テスト: curl を使用して API にアクセス可能かテスト

# API にアクセス可能かテスト(あなたのサーバーアドレスに置き換えてください)

curl http://192.168.1.1:11434/v1動作原理

各設定ファイルは以下を独立して維持できます:

API キーと認証情報

モデル選択

温度設定(応答のランダム性を制御)

VJSP での設定

ステップ 1: モデル設定を開く

- IDE で、VJSP アイコンをクリック

- 右上隅の「設定」インターフェースをクリック

- 「モデル設定」タブを選択して設定ページに移動

注意:

defaultは VJSP によって事前に設定された設定ファイルで、変更は推奨されません。ローカルモデルを使用する場合は、新しい設定ファイルを作成してください。

ステップ 2: 新規設定を作成

「+」 ボタンをクリックして新しい設定ファイルを作成します。

ステップ 3: 設定パラメータを入力

| 設定項目 | 説明 | 例値 |

|---|---|---|

| 設定ファイル名 | 識別しやすいカスタム名 | Internal-Qwen3.5 または TEST |

| API プロバイダー | OpenAI Compatible を選択 | OpenAI Compatible |

| OpenAI ベース URL | ローカル大規模モデルサーバーの完全 API アドレス | http://192.168.1.1:11434/v1 |

| API キー | サーバーが必要な API キー(認証がない場合は任意の値、空は不可) | sk-xxx... |

ステップ 4: モデルを選択

正しいサーバーアドレスとキーを入力した後、モデルリストがサーバーから自動的に読み込まれ、ドロップダウンメニューに表示されます。

- ドロップダウンメニューから必要なモデルを選択

- モデル名を手動で入力する必要はありません

ステップ 5: 高度な設定(オプション)

実際のニーズに基づいて以下の設定を調整:

| 設定項目 | 説明 | 推奨値 |

|---|---|---|

| R1 モデルパラメータを有効化 | QWQ/R1 シリーズモデルを使用する場合有効化 | R1 モデル使用時にチェック |

| 従来の OpenAI API 形式を使用 | 旧バージョン API と互換性 | サーバー要件に応じて |

| ストリーミングを有効化 | ストリーミング応答をサポート | ✓ 推奨チェック |

| 最大出力トークンを含む | 出力長を制限 | ✓ 推奨チェック |

ステップ 6: 保存してテスト

- 「保存」 ボタンをクリック

- セッションウィンドウで新規設定モデルを選択

- テストメッセージを送信して接続を検証

設定ファイルの切り替え

2 つの高速切り替え方法がサポートされています:

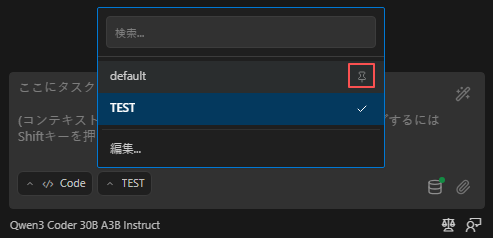

設定パネルで、ドロップダウンメニューから設定ファイルを直接選択。

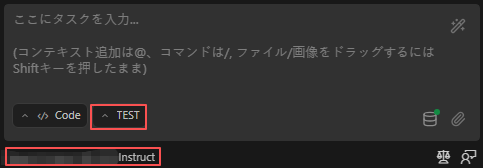

チャットインターフェースで、上部の API 設定ドロップダウンメニューを使用して切り替え。

設定ファイルのピン留めと並べ替え

頻繁に使用する設定ファイルをピン留めして、切り替え効率を向上:

- 設定ファイルにマウスをホバーすると、ピンアイコンが表示。

- ピンアイコンをクリックして設定ファイルをピン留め。

- ピン留めされたファイルはメニュートップに表示され、アルファベット順に並べ替え。

- ピン留めされていないファイルはセパレータの下に表示され、同様にアルファベット順に並べ替え。

- ピンアイコンをもう一度クリックしてピン留めを解除。

この機能により、設定が多数ある場合でも、頻繁に使用する設定ファイル間のナビゲートが容易になります。

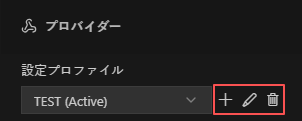

設定ファイルの編集と削除

設定で設定ファイルを選択すると、任意のパラメータを変更可能。

鉛筆アイコンをクリックして設定ファイルをリネーム。

ゴミ箱アイコンをクリックして設定ファイルを削除(最後の設定ファイルは削除不可)。

セキュリティ通知

API キーは IDE の暗号化ストレージ(Secret Storage)に安全に保存され、平文で公開されません。

関連機能

カスタムモードとの統合をサポート

各モードごとに 温度パラメータ の設定をサポート

レート制限と使用統計 によるコスト管理の最適化